深入解析ChatGPT Proxy服务器设置与使用指南,涵盖GitHub、Docker及API接口

在今天这个科技迅速发展的时代,对人工智能的需求日益增长。ChatGPT作为一款由OpenAI研发的大型语言模型,已经在各种领域展现了其强大的对话和自然语言处理能力。然而,在某些情况下,直接访问ChatGPT服务可能会受到限制,这时我们就需要一个ChatGPT Proxy服务器。本篇文章将详细介绍如何通过GitHub资源、Docker容器和API接口来配置和使用ChatGPT Proxy。无论你是新手还是专业人士,都能从这里找到有用的信息和实用技巧。

说在前面

随着ChatGPT应用的普及,如何更加便捷地访问和使用这些服务成为了一个热门话题。本文旨在为读者提供一份详细的ChatGPT Proxy服务器的设置与使用指南,让你能轻松上手,并充分利用相关资源来提升工作效率和开发体验。

你将学到:

– 如何使用GitHub上的资源配置ChatGPT Proxy服务器

– 在Docker中部署ChatGPT Proxy

– 使用API接口进行高效的服务请求和数据处理

ChatGPT Proxy背景介绍

定义和基本概念

ChatGPT Proxy服务器本质上是一种代理服务器,它中转客户端请求到原始的ChatGPT服务,从而实现对服务的访问控制、负载均衡或者访问日志记录等功能。这种方式不仅可以提升服务的稳定性,还能通过代理服务器来做更多的扩展操作。

历史和发展

Proxy服务器的概念并不新鲜,它最早用于网页浏览代理,通过中转服务器提高访问速度,绕过网络限制。随着云计算和微服务架构的发展,Proxy服务器在各种应用中的使用越来越广泛。对于ChatGPT而言,通过Proxy服务器来实现访问控制和请求管理,是解决实际问题的一种有效手段。

ChatGPT Proxy详细解读

使用GitHub资源设置ChatGPT Proxy

在GitHub上有许多开源项目可以帮助你快速搭建ChatGPT Proxy服务器。以下是一个简单步骤:

- 访问GitHub,搜索相关的ChatGPT Proxy项目,例如GoGPTAI/ChatGPT-Proxy

- 克隆项目到本地:

git clone https://github.com/GoGPTAI/ChatGPT-Proxy.git - 按照项目的README文件进行配置,主要包括设置API密钥、代理端口等参数。

- 启动服务器:

npm install && npm start或其它项目指定的启动命令。

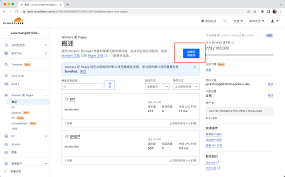

在Docker中部署ChatGPT Proxy

Docker容器使得应用的部署和管理更加简单高效。以下是如何在Docker中部署ChatGPT Proxy的步骤:

- 首先,在本地安装Docker(如果尚未安装):

https://docs.docker.com/get-docker/ - 拉取ChatGPT Proxy的Docker镜像:

docker pull chatgpt-proxy:latest - 创建并运行Docker容器:

docker run -d -p 8080:80 chatgpt-proxy:latest - 确保容器运行正常:

docker ps查看正在运行的容器。

使用API接口访问ChatGPT Proxy

一旦ChatGPT Proxy服务器配置成功,使用API接口进行访问和请求变得非常简单。你只需要通过HTTP请求来与代理服务器交互:

例如,使用Python的requests库:

import requests

api_url = "http://your-proxy-server:8080/api"

headers = {

"Authorization": "Bearer YOUR_ACCESS_TOKEN",

"Content-Type": "application/json"

}

data = {

"prompt": "Tell me a joke.",

"max_tokens": 50

}

response = requests.post(api_url, headers=headers, json=data)

print(response.json())

ChatGPT Proxy相关Tips

- 定期更新:保持你的ChatGPT Proxy项目和Docker镜像定期更新,以确保获取最新的功能和安全补丁。

- 配置安全性:务必设置API密钥和访问控制,以防止未经授权的访问。

- 优化性能:根据你的使用场景,调整代理服务器的配置,如增加缓存策略、负载均衡等。

- 记录日志:设置请求日志记录,以便后期分析和调试。

- 监控与报警:使用监控工具(如Prometheus、Grafana)实时监控服务器运行状态,设置报警机制。

ChatGPT Proxy常见问题解答(FAQ)

1. 什么是ChatGPT Proxy?

ChatGPT Proxy是一种代理服务器,用来中转客户端对ChatGPT服务的请求,以实现访问控制和请求管理。

2. 为什么需要使用ChatGPT Proxy?

使用ChatGPT Proxy有助于管理和优化对ChatGPT服务的访问,提升访问稳定性和安全性,同时还能实现负载均衡和功能扩展。

3. 如何配置ChatGPT Proxy?

可以通过GitHub上的开源项目进行配置,或者使用Docker容器部署,还可以通过API接口进行访问和调用。

4. ChatGPT Proxy对性能有影响吗?

适当配置的ChatGPT Proxy服务器可以优化请求流量,并不会对性能造成显著影响,反而有助于提升服务的总体性能。

5. 如何确保ChatGPT Proxy的安全性?

可以通过设置API密钥、访问控制列表,使用HTTPS加密传输等手段来增强ChatGPT Proxy的安全性。

总结

通过本文的详细介绍,相信你已经掌握了如何通过GitHub资源、Docker容器和API接口来配置和使用ChatGPT Proxy服务器。无论是构建稳定、可扩展的服务访问,还是提升ChatGPT应用的使用体验,通过配置ChatGPT Proxy都能达到事半功倍的效果。赶紧行动起来,配置你的ChatGPT Proxy服务器,开启高效稳定的GPT体验之旅吧!